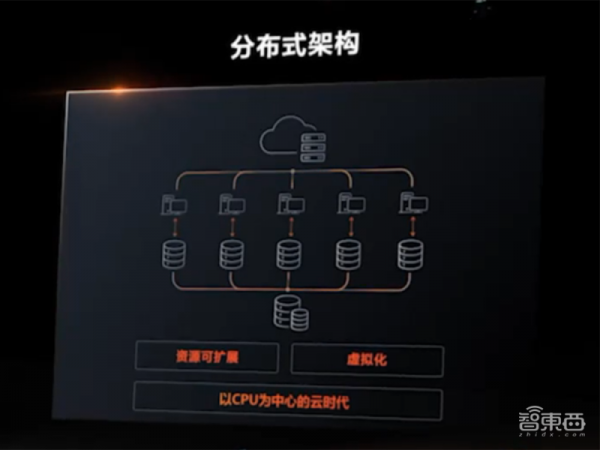

其中,第一阶段分布式技术解决了供应链弹性、整体可扩展性和部分资源利用率问题,推动互联网企业从大机向分布式系统整个迁移。

分布式架构示意图

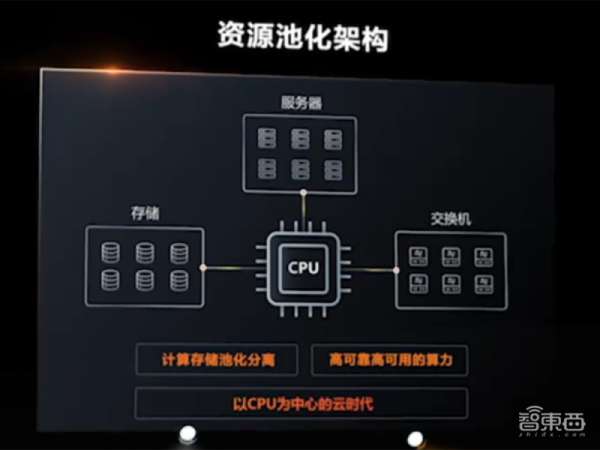

第二阶段资源池化技术通过计算、存储分离的架构,对基础算力资源统一调度编排,提高云计算的可靠性和可用性。

资源池化架构示意图

然而,当云计算规模达到庞大的量级后,纯软件定义的云在实现整体管理调度方面会出现基础设施管理效率、安全风险等难题。

同时,在AI、大数据等新兴应用的发展驱动下,数据密集型计算越来越多,东西向网络流量日益增大,传统以CPU为中心的计算体系架构日渐面临计算与网络传输时延的高要求与整体I/O性能虚拟化损耗的挑战。

这驱使阿里云率先迈向云计算技术的第三阶段--自研云基础设施处理器(CIPU)。

二、性能超国际先进水平,更高稳定性和性价比

何为CIPU?

它是国内唯一自研云计算操作系统飞天的最强硬件搭档,是连接服务器内硬件与云上抽象虚拟化资源的数据中心"第三颗主力芯片"。

作为阿里云底层的"定海神针",飞天将阿里云遍布全球的上百万服务器连成一台超级计算机,为全社会输送算力。而CIPU的出现,将把整体性能提升至新的水平。

值得注意的是,CIPU并非最小颗粒度的芯片,整个硬件由阿里云自研,形态类似英伟达GPU显卡或DPU智能网卡。不过阿里云暂未透露其具体的内部构造。

底层基础设施通过插入CIPU而云化,能够托管在飞天云操作系统之中,进而形成了云上的统一虚拟资源池,并供客户使用云上算力。

CIPU的主要功能

总体来说,CIPU有两大功能:一是具备对底层基础设施资源的虚拟化管理能力,二是能承载飞天对这些资源的编排和调度需求,并具备存储、网络、计算、安全等硬件加速能力。

- 存储方面,其对存算分离架构的块存储接入进行硬件加速,提供超高性能的云盘。

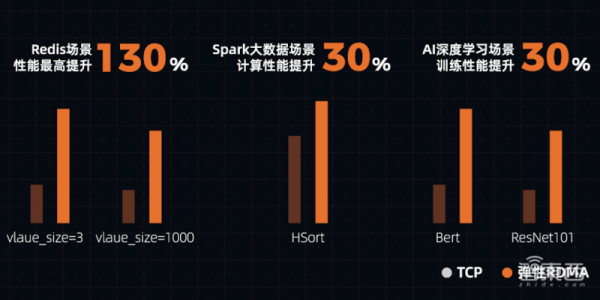

- 网络方面,其对高带宽物理网络进行硬件加速,通过建设大规模的弹性RDMA分布式高性能网络,实现RDMA技术的普惠化,客户无需修改代码,即可享受CIPU的加速红利。

- 计算方面,CIPU快速接入不同类型资源的神龙服务器,带来算力的"0"损耗,以及硬件级安全的加固隔离能力(可信根、数据加解密等)。

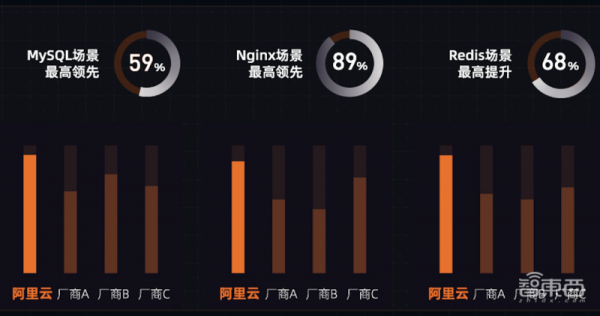

主流通用计算场景下性能领先

无论从名字还是功能来看,CIPU与两大数据中心计算芯片主宰者英特尔、英伟达近两年力推的IPU、DPU概念颇有相似之处。

传统云计算体系架构中,以CPU为中心的架构存在数据吞吐小、延迟要求高等特征,在CPU多核高密化趋势下,英特尔演进出IPU,基于与云厂商合作的经验,提高数据密集型场景的能力;以GPU为中心的架构数据吞吐量大,英伟达进而推出DPU,向虚拟化云化的数据中心市场渗透。

但IPU代表的虚拟化云化能力,和DPU代表的数据搬迁带宽能力,在云服务大规模场景,很难融合落地。

CIPU则能突破以上两者瓶颈,让整个云数据中心内的服务器形态以"CIPU+飞天"为中心,各项性能远超国际最先进水平:

(1)存储:通过全硬件虚拟化和转发加速,存储时延最低可至30μs(PLX),IOPS高达300万,存储带宽可达200Gbps,全面超越市面上所有云产品;支持云上多计算节点NVME共享访问云盘块存储,Oracle RAC、SAP Hana等高可用数据库可无缝上云。

(2)网络:基础带宽从100G增至200G,VPC的TCP下PPS转发性能从2000万升至4000万,TCP网络时延从22μs降至16μs,RDMA协议下低至5.5μs。

(3)计算:单容器虚拟化消耗减少50%,虚拟化容器启动速度快350%;虚拟化"0消耗",结合高性能的存储和网络能力,通用在线分布式应用上云后,比自建物理机的集群吞吐量提升了30%,业务高峰期延迟下降了90%。在普惠化的eRDMA高性能网络加速下,AI深度学习场景下训练性能提升30%,大数据场景下Spark计算性能提升30%。

弹性RDMA全面加速

可以看到,无论是在分布式应用还是AI场景测试中,"CIPU+飞天"都展现出了更优越的性能。

由于阿里云提供的是标准的、开放的算力资源和编程接口,云上客户并不会被"锁定"在阿里云的底层基础设施中。

最终,客户感受到的是云上算力资源跑得更快,服务更稳定了,性价比也变得更好了。

而这些本事,可不是阿里云一朝一夕练就的。